首页 > Python资料 博客日记

YOLOv8 从环境搭建到推理训练

2024-02-26 13:00:04Python资料围观831次

0、引言

硬件配置:使用Mobaxterm_personal_21.4远程操控3060服务器(Linux系统),CUDA版本11.7。

使用anaconda作为python环境环境,python为3.8版本。(最好使用3.8版本)

本文最终安装的pytorch版本是1.13.1,torchvision版本是0.14.1,其他的依赖库按照requirements.txt文件安装即可。

YOLOv8创新点:🍺🍺🍺 1😃Backbone。使用的依旧是CSP的思想,不过YOLOv5中的C3模块被替换成了C2f模块,实现了进一步的轻量化,同时YOLOv8依旧使用了YOLOv5等架构中使用的SPPF模块; 2😁PAN-FPN。毫无疑问YOLOv8依旧使用了PAN的思想,不过通过对比YOLOv5与YOLOv8的结构图可以看到,YOLOv8将YOLOv5中PAN-FPN上采样阶段中的卷积结构删除了,同时也将C3模块替换为了C2f模块 3😑Decoupled-Head。是不是嗅到了不一样的味道?是的,YOLOv8走向了Decoupled-Head; 4😂Anchor-Free。YOLOv8抛弃了以往的Anchor-Base,使用了Anchor-Free的思想; 5😊损失函数。YOLOv8使用VFL Loss作为分类损失,使用DFL Loss+CIOU Loss作为分类损失; 6😚样本匹配。YOLOv8抛弃了以往的IOU匹配或者单边比例的分配方式,而是使用了Task-Aligned Assigner匹配方式。 |

1、代码下载

代码连接:

https://github.com/ultralytics/ultralytics

权重连接:

https://github.com/ultralytics/assets/releases

先睹为快:

下载:点击右上角的绿色Code按钮,再点击Download,即可完成代码下载。下载之后导入到服务器端解压。

解压之后如下图所示。

2、环境准备

2.1创建新环境

启动远程软件,进入base环境,创建新环境yolov8。

conda create -n yolov8 python=3.8激活新环境yolov8。

conda activate yolov82.2安装依赖(各种第三方库)

运行requirements.txt文件即可完成对所有库的安装,包括pytorch等众多第三方库。

运行该文件需要先进入到该文件所在的文件夹:cd 各层文件夹。进入所在文件夹之后再运行该文件。

pip install -r requirements.txt -i https://mirrors.bfsu.edu.cn/pypi/web/simple/2.3安装ultralytics

ultralytics集成了yolo的各种包以及模型等,程序中直接调用。

pip install ultralytics2.4手动下载权重

虽然在(2)中可以自动下载yolov8n.pt,但是经常打不开,所以给出手动下载连接。

下载链接:https://github.com/ultralytics/assets/releases/download/v0.0.0/yolov8n.pt

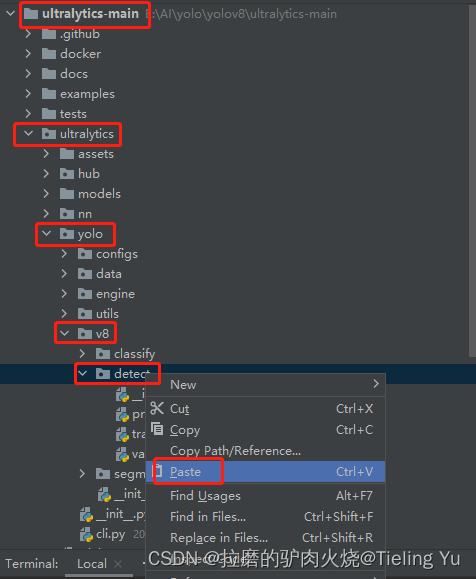

位置:拷到yolov8\ultralytics-main\ultralytics\yolo\v8\detect\yolov8n.pt

3、测试运行

操作:首先进入到yolov8\ultralytics-main\ultralytics\yolo\v8\detect\predict.py,运行predict.py

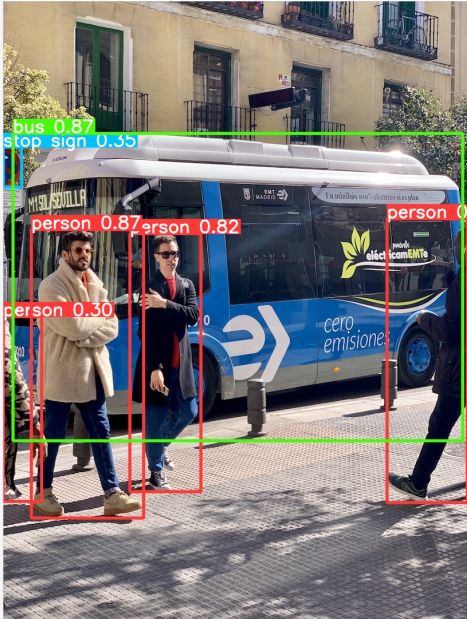

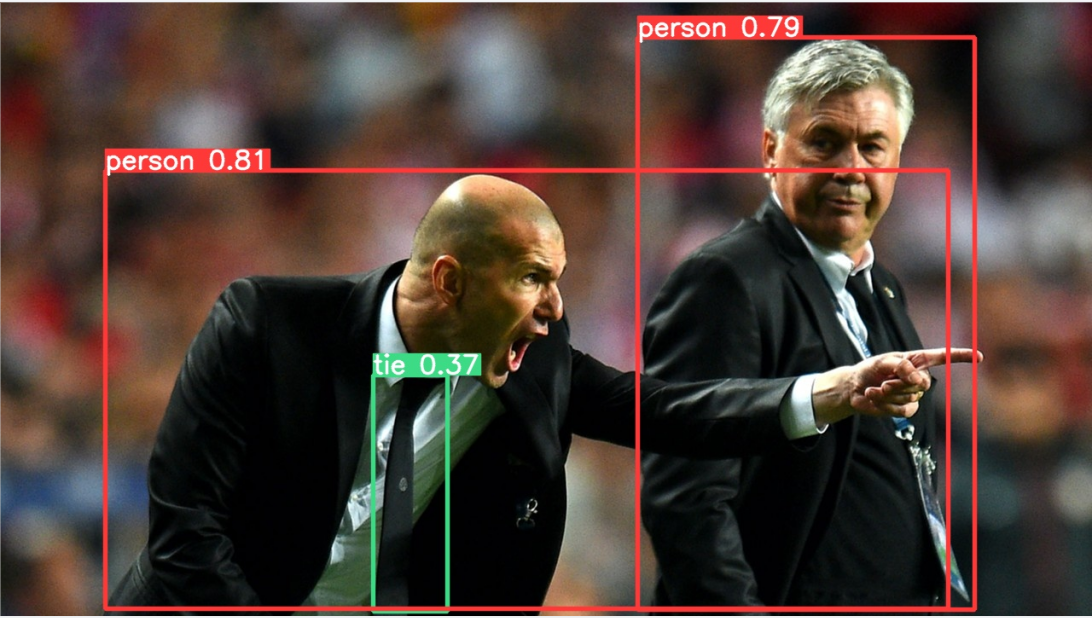

python predict.py完成测试:

查看结果:

4、训练自己的数据

4.1数据准备

由于本文的实验是进行图像检测,故将数据集放在detect目录下。

操作:在detect文件下新建mydata_tuomin文件夹(可自定义),再在mydata_tuomin目录下新建Annotations, images, ImageSets, labels 四个文件夹。

📌Annotations目录下存放图片的xml文件 📌images目录下存放数据集的图片文件 📌ImageSets 目录之后会在Main文件夹内自动生成train.txt,val.txt,test.txt和trainval.txt四个文件 📌labels目录下存放xml文件转换后的txt标准格式标签 |

4.2按比例划分数据集

操作:在detect目录下新建一个文件splitDataset.py,运行。

作用:随机分配训练/验证/测试集图片,会在ImageSet 目录下生成四个txt文件,存放训练集、验证集、测试集的划分文件(各集合包含的图片)。

代码如下所示:

import os

import random

trainval_percent = 0.9

train_percent = 0.9

xmlfilepath = 'mydata_tuomin/Annotations'

txtsavepath = 'mydata_tuomin/ImageSets'

total_xml = os.listdir(xmlfilepath)

num = len(total_xml)

list = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list, tv)

train = random.sample(trainval, tr)

ftrainval = open('mydata_tuomin/ImageSets/trainval.txt', 'w')

ftest = open('mydata_tuomin/ImageSets/test.txt', 'w')

ftrain = open('mydata_tuomin/ImageSets/train.txt', 'w')

fval = open('mydata_tuomin/ImageSets/val.txt', 'w')

for i in list:

name = total_xml[i][:-4] + '\n'

if i in trainval:

ftrainval.write(name)

if i in train:

ftrain.write(name)

else:

fval.write(name)

else:

ftest.write(name)

ftrainval.close()

ftrain.close()

fval.close()

ftest.close()

查看结果:

4.3标签格式转换

由于yolov8使用的labels是txt格式的文件,故需将原始数据集xml格式的标签转换为txt格式。

即将每个xml标注提取box信息为txt格式,每个图像对应一个txt文件,文件每一行为一个目标的信息,包括class, x_center, y_center, width, height格式。

操作:在detect目录下新建一个文件XML2TXT.py,运行。

📌注意代码第11行,classes = ['…']一定需要填写自己数据集的类别,在这里我是三个类别'greenplate','blueplate','face'。 📌如果数据集中的类别不知道或者比较多不想手敲,可以使用4.4中的脚本直接获取类别,如果不需要可以直接跳过4.4。 |

结果:生成的标签存放在labels目录下,并且在mydata_tuomin目录下生成三个txt文件,文件内是训练集、验证集、测试集的图片路径。

代码如下:

# -*- coding: utf-8 -*-

# xml解析包

import xml.etree.ElementTree as ET

import pickle

import os

from os import listdir, getcwd

from os.path import join

sets = ['train', 'test', 'val']

classes = ['greenplate','blueplate','face']

# 进行归一化操作

def convert(size, box): # size:(原图w,原图h) , box:(xmin,xmax,ymin,ymax)

dw = 1./size[0] # 1/w

dh = 1./size[1] # 1/h

x = (box[0] + box[1])/2.0 # 物体在图中的中心点x坐标

y = (box[2] + box[3])/2.0 # 物体在图中的中心点y坐标

w = box[1] - box[0] # 物体实际像素宽度

h = box[3] - box[2] # 物体实际像素高度

x = x*dw # 物体中心点x的坐标比(相当于 x/原图w)

w = w*dw # 物体宽度的宽度比(相当于 w/原图w)

y = y*dh # 物体中心点y的坐标比(相当于 y/原图h)

h = h*dh # 物体宽度的宽度比(相当于 h/原图h)

return (x, y, w, h) # 返回 相对于原图的物体中心点的x坐标比,y坐标比,宽度比,高度比,取值范围[0-1]

# year ='2012', 对应图片的id(文件名)

def convert_annotation(image_id):

# 对应的通过year 找到相应的文件夹,并且打开相应image_id的xml文件,其对应bund文件

in_file = open('mydata_tuomin/Annotations/%s.xml' % (image_id), encoding='utf-8')

# 准备在对应的image_id 中写入对应的label,分别为

# <object-class> <x> <y> <width> <height>

out_file = open('mydata_tuomin/labels/%s.txt' % (image_id), 'w', encoding='utf-8')

# 解析xml文件

tree = ET.parse(in_file)

# 获得对应的键值对

root = tree.getroot()

# 获得图片的尺寸大小

size = root.find('size')

# 如果xml内的标记为空,增加判断条件

if size != None:

# 获得宽

w = int(size.find('width').text)

# 获得高

h = int(size.find('height').text)

# 遍历目标obj

for obj in root.iter('object'):

# 获得difficult ??

difficult = obj.find('difficult').text

# 获得类别 =string 类型

cls = obj.find('name').text

# 如果类别不是对应在我们预定好的class文件中,或difficult==1则跳过

if cls not in classes or int(difficult) == 1:

continue

# 通过类别名称找到id

cls_id = classes.index(cls)

# 找到bndbox 对象

xmlbox = obj.find('bndbox')

# 获取对应的bndbox的数组 = ['xmin','xmax','ymin','ymax']

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

print(image_id, cls, b)

# 带入进行归一化操作

# w = 宽, h = 高, b= bndbox的数组 = ['xmin','xmax','ymin','ymax']

bb = convert((w, h), b)

# bb 对应的是归一化后的(x,y,w,h)

# 生成 calss x y w h 在label文件中

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

# 返回当前工作目录

wd = getcwd()

print(wd)

for image_set in sets:

# 先找labels文件夹如果不存在则创建

if not os.path.exists('mydata_tuomin/labels/'):

os.makedirs('mydata_tuomin/labels/')

# 读取在ImageSets/Main 中的train、test..等文件的内容

# 包含对应的文件名称

image_ids = open('mydata_tuomin/ImageSets/%s.txt' % (image_set)).read().strip().split()

# 打开对应的2012_train.txt 文件对其进行写入准备

list_file = open('mydata_tuomin/%s.txt' % (image_set), 'w')

# 将对应的文件_id以及全路径写进去并换行

for image_id in image_ids:

list_file.write('mydata_tuomin/images/%s.jpg\n' % (image_id))

# 调用 year = 年份 image_id = 对应的文件名_id

convert_annotation(image_id)

# 关闭文件

list_file.close()

4.4查看自己的数据集标签类别

操作:在detect目录下新建一个文件ViewCategory.py,运行。

代码如下:(文件路径也可以使用绝对路径)

# coding=gbk

import xml.dom.minidom as xmldom

import os

#voc数据集获取所有标签的所有类别数"

annotation_path="/mydata_tuomin/Annotations/"

annotation_names=[os.path.join(annotation_path,i) for i in os.listdir(annotation_path)]

labels = list()

for names in annotation_names:

xmlfilepath = names

domobj = xmldom.parse(xmlfilepath)

# 得到元素对象

elementobj = domobj.documentElement

#获得子标签

subElementObj = elementobj.getElementsByTagName("object")

for s in subElementObj:

label=s.getElementsByTagName("name")[0].firstChild.data

#print(label)

if label not in labels:

labels.append(label)

print(labels)

4.5创建数据加载配置文件

操作:在mydata_tuomin文件夹下新建一个tuomin.yaml文件(可以自定义命名),用来存放训练集、验证集、测试集的路径文件(train.txt、val.txt、test.txt),以上三个文件是在步骤4.3中生成的路径文件(存放在mydata_tuomin目录下),然后是目标的类别数目和具体类别列表。

代码如下:❗❗❗注意txt需要使用绝对路径。

train: /home/xxxxxx/Yolov8/ultralyticsmain/ultralytics/yolo/v8/detect/mydata_tuomin/train.txt

val: /home/xxxxxx/Yolov8/ultralyticsmain/ultralytics/yolo/v8/detect/mydata_tuomin/val.txt

test: /home/xxxxxx/Yolov8/ultralyticsmain/ultralytics/yolo/v8/detect/mydata_tuomin/test.txt

# number of classes

nc: 3

# class names

names: ['greenplate', 'blueplate', 'face']

4.6选择模型

在ultralytics/models/v8/目录下是模型的配置文件,提供了n、s、m、l、x版本,逐渐增大(随着架构的增大,训练时间也是逐渐增大),五种模型对比图如下所示。

操作:本文限于硬件配置,采用yolov8s.yaml,接下来只用修改一个参数,把nc改成自己的类别数

代码如下:

# Ultralytics YOLO 馃殌, GPL-3.0 license

# Parameters

nc: 3 # number of classes(只需要改这里!!!!!!!)

depth_multiple: 0.33 # scales module repeats

width_multiple: 0.50 # scales convolution channels

# YOLOv8.0s backbone

backbone:

# [from, repeats, module, args]

- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2]] # 1-P2/4

- [-1, 3, C2f, [128, True]]

- [-1, 1, Conv, [256, 3, 2]] # 3-P3/8

- [-1, 6, C2f, [256, True]]

- [-1, 1, Conv, [512, 3, 2]] # 5-P4/16

- [-1, 6, C2f, [512, True]]

- [-1, 1, Conv, [1024, 3, 2]] # 7-P5/32

- [-1, 3, C2f, [1024, True]]

- [-1, 1, SPPF, [1024, 5]] # 9

# YOLOv8.0s head

head:

- [-1, 1, nn.Upsample, [None, 2, 'nearest']]

- [[-1, 6], 1, Concat, [1]] # cat backbone P4

- [-1, 3, C2f, [512]] # 13

- [-1, 1, nn.Upsample, [None, 2, 'nearest']]

- [[-1, 4], 1, Concat, [1]] # cat backbone P3

- [-1, 3, C2f, [256]] # 17 (P3/8-small)

- [-1, 1, Conv, [256, 3, 2]]

- [[-1, 12], 1, Concat, [1]] # cat head P4

- [-1, 3, C2f, [512]] # 20 (P4/16-medium)

- [-1, 1, Conv, [512, 3, 2]]

- [[-1, 9], 1, Concat, [1]] # cat head P5

- [-1, 3, C2f, [1024]] # 23 (P5/32-large)

- [[15, 18, 21], 1, Detect, [nc]] # Detect(P3, P4, P5)

4.7开始训练

输入如下命令开始训练。

yolo task=detect mode=train model=yolov8s.yaml data=mydata_tuomin/tuomin.yaml epochs=100 batch=4以上参数解释如下: 📌task:选择任务类型,可选['detect', 'segment', 'classify', 'init']。 📌mode: 选择是训练、验证还是预测的任务蕾西 可选['train', 'val', 'predict']。 📌model: 选择yolov8不同的模型配置文件,可选yolov8s.yaml、yolov8m.yaml、yolov8x.yaml等。 📌data: 选择生成的数据集配置文件 📌epochs:指的就是训练过程中整个数据集将被迭代多少次,显卡不行你就调小点。 📌batch:一次看完多少张图片才进行权重更新,梯度下降的mini-batch,显卡不行你就调小点。 |

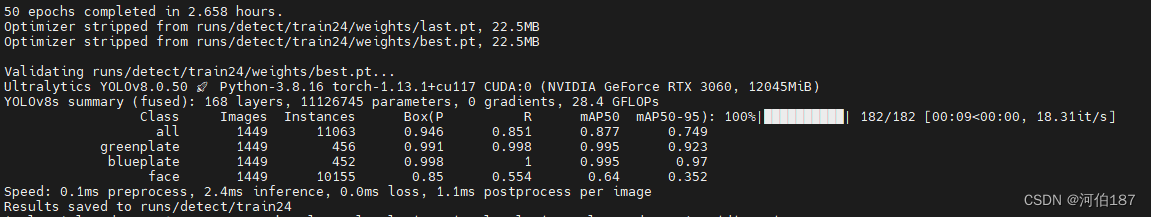

查看训练过程:

查看结果:

标签:

相关文章

最新发布

- 光流法结合深度学习神经网络的原理及应用(完整代码都有Python opencv)

- Python 图像处理进阶:特征提取与图像分类

- 大数据可视化分析-基于python的电影数据分析及可视化系统_9532dr50

- 【Python】入门(运算、输出、数据类型)

- 【Python】第一弹---解锁编程新世界:深入理解计算机基础与Python入门指南

- 华为OD机试E卷 --第k个排列 --24年OD统一考试(Java & JS & Python & C & C++)

- Python已安装包在import时报错未找到的解决方法

- 【Python】自动化神器PyAutoGUI —告别手动操作,一键模拟鼠标键盘,玩转微信及各种软件自动化

- Pycharm连接SQL Sever(详细教程)

- Python编程练习题及解析(49题)

点击排行

- 版本匹配指南:Numpy版本和Python版本的对应关系

- 版本匹配指南:PyTorch版本、torchvision 版本和Python版本的对应关系

- Anaconda版本和Python版本对应关系(持续更新...)

- 相关性分析——Pearson相关系数+热力图(附data和Python完整代码)

- Python 可视化 web 神器:streamlit、Gradio、dash、nicegui;低代码 Python Web 框架:PyWebIO

- Windows上安装 Python 环境并配置环境变量 (超详细教程)

- Python与PyTorch的版本对应

- 安装spacy+zh_core_web_sm避坑指南